前言

当你开始大规模使用Docker时,你会发现需要了解很多关于网络的知识。Docker作为目前最火的轻量级容器技术,有很多令人称道的功能,如Docker的镜像管理。然而,Docker同样有着很多不完善的地方,网络方面就是Docker比较薄弱的部分。因此,作为一名运维工程师有必要深入了解Docker的网络知识,以满足更高的网络需求。作为一名微服开发工程师,简单了解Docker网络环节即可。

Docker安装后会自动创建3种网络:

- bridge

- host

- none

查看Docker的网络列表命令如下:

docker network lsDocker网络理论部分

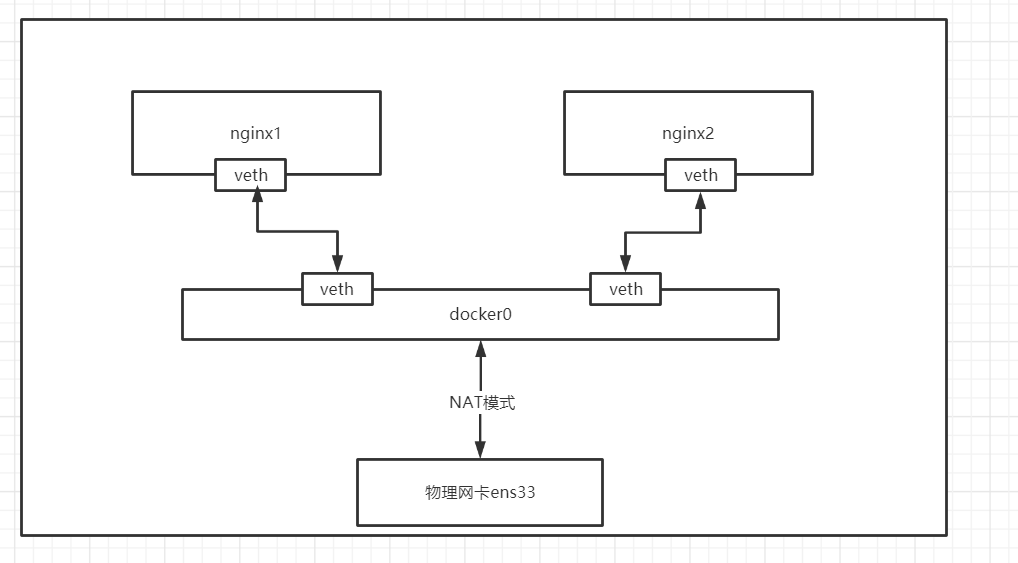

Docker使用Linux桥接网卡,在宿主机虚拟一个Docker容器网桥(docker0),Docker启动一个容器时会根据Docker网桥的网段分配给容器一个IP地址,称为Container-IP,同时Docker网桥是每个容器的默认网关。因为在同一宿主机内的容器都接入同一个网桥,这样容器之间就能够通过容器的Container-IP直接通信。

Docker网桥是宿主机虚拟出来的,并不是真实存在的网络设备,外部网络是无法寻址到的,这也意味着外部网络无法通过直接Container-IP访问到容器。如果容器希望外部访问能够访问到,可以通过映射容器端口到宿主主机(端口映射),即docker run创建容器时候通过-p或-P参数来启用,访问容器的时候就通过[宿主机IP]:[容器端口]访问容器。

Bridge模式

默认的网络模式。bridge模式下容器没有一个公有IP,只有宿主机可以直接访问,外部主机是不可见的,但容器通过宿主机的NAT规则后可以访问外网。

Bridge桥接模式的实现步骤主要如下:

- Docker Daemon利用veth pair技术,在宿主机上创建两个虚拟网络接口设备,假设为veth0和veth1。而veth pair技术的特性可以保证无论哪一个veth接收到网络报文,都会将报文传输给另一方

- Docker Daemon将veth0附加到Docker Daemon创建的docker0网桥上。保证宿主机的网络报文可以发往 veth0

- Docker Daemon将veth1添加到Docker Container所属的namespace下,并被改名为eth0。如此一来,保证宿主机的网络报文若发往veth0,则立即会被eth0接收,实现宿主机到Docker Container网络的联通性;同时,也保证Docker Container单独使用eth0,实现容器网络环境的隔离性

Bridge桥接模式的缺陷:

- 最明显的是,该模式下Docker Container不具有一个公有IP,即和宿主机的eth0不处于同一个网段。导致的结果是宿主机以外的世界不能直接和容器进行通信

- 虽然NAT模式经过中间处理实现了这一点,但是NAT模式仍然存在问题与不便,如:容器均需要在宿主机上竞争端口,容器内部服务的访问者需要使用服务发现获知服务的外部端口等

- 另外NAT模式由于是在三层网络上的实现手段,故肯定会影响网络的传输效率

注意:veth设备是成双成对出现的,一端是容器内部命名为eth0,一端是加入到网桥并命名的veth(通常命名为veth),它们组成了一个数据传输通道,一端进一端出,veth设备连接了两个网络设备并实现了数据通信

Host模式

相当于Vmware中的NAT模式,与宿主机在同一个网络中,但没有独立IP地址。

如果启动容器的时候使用Host模式,那么这个容器将不会获得一个独立的Network Namespace,而是和宿主机共用一个Network Namespace。容器将不会虚拟出自己的网卡,配置自己的IP等,而是使用宿主机的IP和端口。但是,容器的其他方面,如文件系统、进程列表等还是和宿主机隔离的。

使用Host模式的容器可以直接使用宿主机的IP地址与外界通信,容器内部的服务端口也可以使用宿主机的端口,不需要进行NAT,Host最大的优势就是网络性能比较好,但是Docker Host上已经使用的端口就不能再用了,网络的隔离性不好。

Host网络模式的缺陷:

最明显的是Docker Container网络环境隔离性的弱化。即容器不再拥有隔离、独立的网络环境。另外,使用Host模式的Docker Container虽然可以让容器内部的服务和传统情况无差别、无改造的使用,但是由于网络隔离性的弱化,该容器会与宿主机共享竞争网络栈的使用。

Container模式

Container网络模式是Docker中一种较为特别的网络的模式。在容器创建时使用–network=container:vm1指定(vm1指定的是运行的容器名)。

处于这个模式下的Docker容器会共享一个网络环境,这样两个容器之间可以使用localhost高效快速通信。

缺陷:它并没有改善容器与宿主机以外世界通信的情况(和桥接模式一样,不能连接宿主机以外的其他设备)。

这个模式指定新创建的容器和已经存在的一个容器共享一个Network Namespace,而不是和宿主机共享。新创建的容器不会创建自己的网卡,配置自己的 IP,而是和一个指定的容器共享 IP、端口范围等。同样,两个容器除了网络方面,其他的如文件系统、进程列表等还是隔离的。两个容器的进程可以通过lo网卡设备通信。

None模式

使用None模式,Docker容器拥有自己的Network Namespace,但是,并不为Docker容器进行任何网络配置。也就是说,这个Docker容器没有网卡、IP、路由等信息。需要我们自己为Docker容器添加网卡、配置IP等。

这种网络模式下容器只有lo回环网络,没有其他网卡。None模式可以在容器创建时通过--network=none来指定。这种类型的网络没有办法联网,封闭的网络能很好的保证容器的安全性。

Overlay模式

Overlay网络,也称为覆盖网络。主要用于Docker集群部署。

Overlay网络的实现方式和方案有多种。Docker自身集成了一种,基于VXLAN隧道技术实现。

Overlay网络主要用于实现跨主机容器之间的通信。

应用场景:需要管理成百上千个跨主机的容器集群的网络时。

Macvlan模式

Macvlan网络模式,最主要的特征就是他们的通信会直接基于MAC地址进行转发。这时宿主机其实充当一个二层交换机。Docker会维护着一个MAC地址表,当宿主机网络收到一个数据包后,直接根据MAC地址找到对应的容器,再把数据交给对应的容器。

容器之间可以直接通过IP互通,通过宿主机上内建的虚拟网络设备(创建macvlan网络时自动创建),但与主机无法直接利用IP互通。

应用场景:由于每个外来的数据包的目的MAC地址就是容器的MAC地址,这时每个容器对于外面网络来说就相当于一个真实的物理网络设备。因此当需要让容器来的网络看起来是一个真实的物理机时,使用Macvlan模式。

Macvlan是一个新的尝试,是真正的网络虚拟化技术的转折点。Linux实现非常轻量级,因为与传统的Linux Bridge隔离相比,它们只是简单地与一个Linux以太网接口或子接口相关联,以实现网络之间的分离和与物理网络的连接。

Macvlan提供了许多独特的功能,并有充足的空间进一步创新与各种模式。这些方法的两个高级优点是绕过Linux网桥的正面性能以及移动部件少的简单性。删除传统上驻留在Docker主机NIC和容器接口之间的网桥留下了一个非常简单的设置,包括容器接口,直接连接到Docker主机接口。由于在这些情况下没有端口映射,因此可以轻松访问外部服务。

Macvlan Bridge模式每个容器都有唯一的MAC地址,用于跟踪Docker主机的MAC到端口映射。Macvlan驱动程序网络连接到父Docker主机接口。示例是物理接口,例如eth0,用802.1q VLAN标记的子接口eth0.10(.10代表VLAN 10)或甚至绑定的主机适配器,将两个以太网接口捆绑为单个逻辑接口。 指定的网关由网络基础设施提供的主机外部。 每个Macvlan Bridge模式的Docker网络彼此隔离,一次只能有一个网络连接到父节点。

每个主机适配器有一个理论限制,每个主机适配器可以连接一个Docker网络。 同一子网内的任何容器都可以与没有网关的同一网络中的任何其他容器进行通信Macvlan Bridge。 相同的docker network命令适用于vlan驱动程序。 在Macvlan模式下,在两个网络/子网之间没有外部进程路由的情况下,单独网络上的容器无法互相访问。这也适用于同一码头网络内的多个子网。

Docker网络实战

环境准备

拉取镜像:

docker pull nginx:1.19.3-alpine备份镜像:

docker save nginx:1.19.3-alpine -o nginx.1.19.3.alpine.tar导入镜像:

docker load -i nginx.1.19.3.alpine.tarBridge网络

Bridge网络表现形式就是docker0这个网络接口。容器默认都是通过docker0这个接口进行通信。也可以通过docker0去和本机的以太网接口连接,这样容器内部才能访问互联网。

查看docker网络

docker network ls

查看bridge网络详情。主要关注Containers节点信息。

docker network inspect bridgedocker0详解

运行镜像:

docker run -itd --name nginx1 nginx:1.19.3-alpine

查看bridge网络详情。主要关注Containers节点信息。发现nginx1容器默认使用bridge网络

docker network inspect bridge容器创建时IP地址的分配:

查看docker100主机网络。发现多出一块网卡veth62aef5e@if8

ip aDocker创建一个容器的时候,会执行如下操作:

- 创建一对虚拟接口/网卡,也就是veth pair,分别放到本地主机和新容器中

- 本地主机一端桥接到默认的docker0 或指定网桥上,并具有一个唯一的名字,如vetha596da4

- 容器一端放到新容器中,并修改名字作为 eth0,这个网卡/接口只在容器的名字空间可见

- 从网桥可用地址段中(也就是与该Bridge对应的Network)获取一个空闲地址分配给容器的eth0,并配置默认路由到桥接网卡vetha596da4

完成这些之后,容器就可以使用eth0虚拟网卡来连接其他容器和其他网络。

如果不指定--network,创建的容器默认都会挂到docker0上,使用本地主机上docker0接口的IP作为所有容器的默认网关。

第一种方式:

docker exec -it nginx1 sh

ip a

第二种方式:

docker exec -it nginx1 ip a安装brctl:

yum install -y bridge-utils运行命令:

brctl show多容器之间通讯

docker run -itd --name nginx1 nginx:1.19.3-alpine

docker run -itd --name nginx2 nginx:1.19.3-alpine

docker network inspect bridge

docker exec -it nginx1 sh

ping 172.17.0.2

docker exec -it nginx2 sh

ping 172.17.0.2

ping www.baidu.com

ping nginx1容器IP地址会发生变化

docker stop nginx1 nginx2

先启动nginx2,在启动nginx1

docker start nginx2

docker start nginx1

docker network inspect bridgelink容器

使用link的场景:在企业开发环境中,我们有一个mysql的服务的容器mysql_1,还有一个web应用程序web_1,肯定web_1这台容器肯定要连接mysql_1这个数据库。前面网络命名空间的知识告诉我们,两个容器需要能通信,需要知道对方的具体的IP地址。生产环境还比较好,IP地址很少变化,但是在我们内部测试环境,容器部署的IP地址是可能不断变化的,所以,开发人员不能在代码中写死数据库的IP地址。这个时候,我们就可以利用容器之间link来解决这个问题。下面,我们来介绍如何通过容器名称来进行ping,而不是通过IP地址。

docker rm -f nginx2

docker run -itd --name nginx2 --link nginx1 nginx:1.19.3-alpine

docker exec -it nginx2 sh

ping 172.17.0.2

ping www.baidu.com

ping nginx1- 上面link命令,是在nginx2容器启动时link到nginx1容器,因此,在nginx2容器里面可以ping通nginx1容器名,link的作用相当于添加了DNS解析。这里提醒下,在nginx1容器里去ping nginx2容器是不通的,因为link关系是单向的,不可逆

- 实际工作中,Docker官网已经不推荐我们使用link参数

- Docker用其他方式替换掉link参数

新建Bridge网络

docker network create -d bridge rubin-bridge上面命令参数-d是指DRIVER的类型,后面的rubin-bridge是network的自定义名称,这个和docker0是类似的。下面开始介绍,如何把容器连接到rubin-bridge这个网络。

启动一个Nginx的容器nginx3,并通过参数network connect来连接rubin-bridge网络。在启动容器nginx3之前,我们查看目前还没有容器连接到了rubin-bridge这个网络上。

brctl show

docker network ls

docker network inspect rubin-bridge

docker run -itd --name nginx3 --network rubin-bridge nginx:1.19.3-alpine

brctl show

docker network inspect rubin-bridge把一个运行中容器连接到rubin-bridge网络:

docker network connect rubin-bridge nginx2

docker network inspect rubin-bridge

docker exec -it nginx2 sh

ping nginx3

docker exec -it nginx3 sh

ping nginx2None网络

环境准备,先stop和rm掉全部之前开启的容器。并且把前面创建的rubin-bridge网络也删除。当然,更简单的办法是使用快照方式。将docker-100主机恢复到docker初始化安装时。

docker rm -f $(docker ps -aq)

docker network rm rubin-bridge

docker network ls启动一个Ngnix的容器nginx1,并且连接到None网络。然后执行docker network inspect none,看看容器信息。

docker run -itd --name nginx1 --network none nginx:1.19.3-alpine

docker network inspect none注意,容器使用None模式,是没有物理地址和IP地址。我们可以进入到nginx1容器里,执行ip a命令看看。只有一个lo接口,没有其他网络接口,没有IP。也就是说,使用None模式,这个容器是不能被其他容器访问。这种使用场景很少,只有项目安全性很高的功能才能使用到。例如:密码加密算法容器。

docker exec -it nginx1 sh

ip aHost网络

前面学习None网络模式特点就是,容器没有IP地址,不能和其他容器通信。下面来看看Host网络是什么特点。我们使用前面命令,启动一个Nginx的nginx2容器,连接到Host网络。然后docker networkinspect host,看看容器信息。

docker run -itd --name nginx2 --network host nginx:1.19.3-alpine

docker network inspect host这里来看,也不显示IP地址。那么是不是和None一样,肯定不是,不然也不会设计None和Host网络进行区分。下面我们进入nginx2容器,执行ip a看看效果。我们在容器里执行ip a,发现打印内容和在Linux本机外执行ip a是一样的。

docker exec -it nginx2 sh

ip a这说明什么呢?容器使用了Host模式,说明容器和外层Linux主机共享一套网络接口。VMware公司的虚拟机管理软件,其中网络设置,也有Host这个模式,作用也是一样,虚拟机里面使用网络和你自己外层机器是一模一样的。这种容器和本机使用共享一套网络接口,缺点还是很明显的,例如我们知道web服务器一般端口是80,共享了一套网络接口,那么你这台机器上只能启动一个Nginx端口为80的服务器了。否则,出现端口被占用的情况。

网络命令汇总

docker network --help

网络常用命令汇总

connect Connect a container to a network

create Create a network

disconnect Disconnect a container from a network

inspect Display detailed information on one or more networks

ls List networks

prune Remove all unused networks

rm Remove one or more networks查看网络

查看网络 – docker network ls

# 作用:

查看已经建立的网络对象

# 命令格式:

docker network ls [OPTIONS]

# 命令参数(OPTIONS):

-f, --filter filter 过滤条件(如 'driver=bridge’)

--format string 格式化打印结果

--no-trunc 不缩略显示

-q, --quiet 只显示网络对象的ID

# 注意:

默认情况下,docker安装完成后,会自动创建bridge、host、none三种网络驱动

# 命令演示

docker network ls

docker network ls --no-trunc

docker network ls -f 'driver=host'创建网络

创建网络 – docker network create

# 作用:

创建新的网络对象

# 命令格式:

docker network create [OPTIONS] NETWORK

# 命令参数(OPTIONS):

-d, --driver string 指定网络的驱动(默认 "bridge")

--subnet strings 指定子网网段(如192.168.0.0/16、172.88.0.0/24)

--ip-range strings 执行容器的IP范围,格式同subnet参数

--gateway strings 子网的IPv4 or IPv6网关,如(192.168.0.1)

# 注意:

host和none模式网络只能存在一个

docker自带的overlay网络创建依赖于docker swarm(集群负载均衡)服务

192.168.0.0/16 等于 192.168.0.0~192.168.255.255

172.88.0.0/24 等于 172.88.0.0~172.88.0.255

# 命令演示

docker network ls

docker network create -d bridge my-bridge

docker network ls网络删除

网络删除 – docker network rm

# 作用:

删除一个或多个网络

# 命令格式:

docker network rm NETWORK [NETWORK...]

# 命令参数(OPTIONS):

无查看网络详细信息

查看网络详细信息 docker network inspect

# 作用:

查看一个或多个网络的详细信息

# 命令格式:

docker network inspect [OPTIONS] NETWORK [NETWORK...]

或者 docker inspect [OPTIONS] NETWORK [NETWORK...]

# 命令参数(OPTIONS):

-f, --format string 根据format输出结果使用网络

使用网络 – docker run –-network

# 作用:

为启动的容器指定网络模式

# 命令格式:

docker run/create --network NETWORK

# 命令参数(OPTIONS):

无

# 注意:

默认情况下,docker创建或启动容器时,会默认使用名为bridge的网络网络连接与断开

网络连接与断开 – docker network connect/disconnect

# 作用:

将指定容器与指定网络进行连接或者断开连接

# 命令格式:

docker network connect [OPTIONS] NETWORK CONTAINER

docker network disconnect [OPTIONS] NETWORK CONTAINER

# 命令参数(OPTIONS):

-f, --force 强制断开连接(用于disconnect)小练习

docker network create -d bridge --subnet=172.172.0.0/24 --gateway 172.172.0.1

rubin-network

172.172.0.0/24: 24代表子码掩码是255.255.255.0

172.172.0.0/16: 16代表子码掩码255.255.0.0

docker network ls

docker run -itd --name nginx3 -p 80:80 --network rubin-network --ip 172.172.0.10 nginx:1.19.3-alpine

--network mynetwork:选择存在的网络

--ip 172.172.0.10:给nginx分配固定的IP地址

docker network inspect rubin-network

docker stop nginx3

docker start nginx3

docker network inspect rubin-network以上就是本文的全部内容。欢迎小伙伴们积极留言交流~~~

文章评论